🔥 Local AI Setup Guide (GGUF + Instruct)

📦 1. Narzędzie (WebUI)

https://github.com/oobabooga/text-generation-webui

✔ działa na Linuxie

✔ ma tryb API

✔ pozwala uruchomić modele lokalnie

🤖 2. Skąd brać modele

https://huggingface.co/models?pipeline_tag=text-generation&library=gguf

- ✔ Instruct

- ✔ GGUF

- ✔ 6B – 128B parametrów

🧠 3. Typy modeli

Instruct vs Base

- Instruct → rozumie polecenia (najlepsze do tasków)

- Base → zwykłe, surowe modele

Rozmiary modeli

- 7B → szybki, tani, do lekkich tasków

- 13B → dużo lepsze rozumienie i logika

- 23B → wysoka jakość, lepsze reasoning

- 40B+ → bardzo zaawansowana jakość, wymagająca sprzętu

👉 Zwykle: więcej parametrów → lepsze rozumienie kontekstu i planowanie.

⚙️ 4. Kwantyzacja GGUF

GGUF = format zoptymalizowany pod wydajność i szybkość.

Poziomy:

- Q2_K → bardzo szybkie, ale słabsza jakość

- Q4 → balans

- Q6_K → dobra jakość

- Q8_0 → naprawde bardzo dobra jakos

- F16 → najlepsza precyzja

ciekawostka: tyle ile model ważdy takie jest zapotrzebowanie na pamięć

Przykłady:

- 13B Q6_K → szybkie, lekka strata jakości

- 13B Q8_0 → wolniejsze, ale dokładniejsze

- 23B F16 → najlepsze i najwolniejsze

👉 Do dokładnych planów i logicznych odpowiedzi: Q8_0 lub F16 jeśli jest dostępna.

🔁 Offloading — uruchamianie modeli GGUF na ograniczonej pamięci

Modele GGUF można offloadować (przenieść wagę na CPU/dysk, co pozwala uruchomić większe modele na maszynach z ograniczoną pamięcią. To zwykle oznacza:

- CPU offload — część wag trzymana poza GPU czyli CPU + ram / wirtualny ram

- Narzędzie (WebUI) właśnie to ogarnia

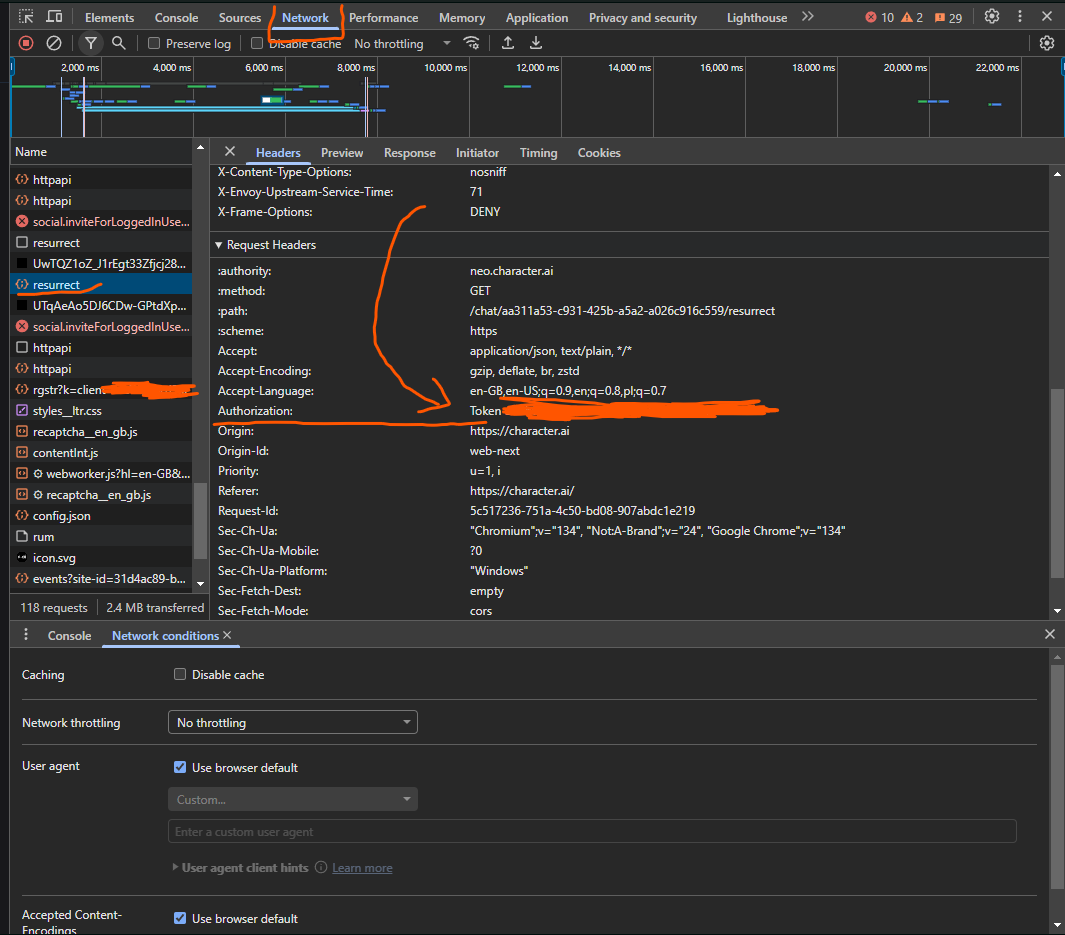

🧩 5. Context Size (ctx-size)

Context size (ctx-size) = ile tokenów model może „widzieć” naraz.

- większy ctx → lepsze zrozumienie długich danych

- po przekroczeniu limitu → model zapomina wcześniejsze rzeczy

WAŻNE:

W modelach GGUF często tej informacji nie ma — trzeba sprawdzić oryginalny model.

Jak to zrobić:

- wejdź na stronę GGUF modelu

- kliknij link do oryginalnego modelu (np. w README)

- sprawdź jego

config.json

Przykład:

https://huggingface.co/Qwen/Qwen2.5-7B-Instruct-1M/blob/main/config.json

{

"max_position_embeddings": 1010000

}

✔ To jest ctx-size ≈ 1M tokenów.

👉 Jeśli GGUF nie pokazuje – szukaj oryginalnego modelu i configu!

🚀 6. Model na start

Dobry start to:

https://huggingface.co/MaziyarPanahi/Mistral-7B-Instruct-v0.3-GGUF

- ✔ 7B – dobra wydajność

- ✔ Instrukcje = model Instruct

- ✔ GGUF – zoptymalizowany

🛠 7. Architektura modeli i MoE

Dlaczego architektura się liczy

Nie tylko liczba parametrów decyduje. Dobra architektura może sprawić, że mniejszy model (7B, 13B) wyprzedzi większy (27B+) w testach logicznych i planowania

Fine‑tuned modele

Fine‑tuned = model dopasowany do konkretnego zadania. 13B FT może bić 27B bez FT bo ma „nauczenie celowe” pod planowanie, QA lub chat

MoE – Mixture of Experts

MoE aktywuje tylko wybrane części mózgu AI podczas generacji. Zamiast 100% neuronu używa np ~27%, wybierając najbardziej trafnych ekspertów. Szybsze i inteligentniejsze generowanie

Najczęściej używane w firmach i większych modelach 27B+, bo daje dużą wydajność przy ograniczonej mocy obliczeniowej

Jak szukać modeli pod planowanie i logiczne zadania

Wpisz tego prompta do ai najlepsze llm na hugging face do tworzenia zaawansowanego planu lekcji z konfliktami, 7b 13b 15b 27b 40b 70b 128b wersje finetunowane pod te taski + kolejne przedstawienie modeli 7b 13b itp które poprostu są dobre w benchmarkach logicznych i planowaniu, content size powinien być też napisany

tutaj mam już output https://chatgpt.com/share/69bac7c6-68b8-800c-8c2c-63a70aba884b

Przykłady ciekawych modeli

- 🔥 7B‑13B: Mistral 7B Instruct, Qwen2.5 7B, Gemma 3 12B, Vicuna 13B

- 🔥 27B+: Gemma 3 27B, Mixtral / MoE style

- 💡 MoE: aktywuje tylko wybrane części mózgu AI (~27%), przyspiesza generację i poprawia trafność odpowiedzi

🧪 8. Qwen2.5‑7B vs Mistral‑7B – przykładowe różnice

Qwen2.5‑7B

- Trenowany na dużych datasetach: web, książki, newsy, kod, STEM → świetny w benchmarkach akademickich

- Wyniki testów: MMLU ~74, GSM8K ~85, MATH ~50, HumanEval ~58

- Silny w matematyce, kodzie, logic reasoning → dokładne i szybkie rozwiązania

- Multilingual (29+ języków), długi context window

- Przykład użycia: rozwiązywanie zadań logicznych i planowanie krok po kroku

Mistral‑7B Instruct

- Trenowany na publicznych danych i fine‑tuning pod instrukcje → kreatywne i płynne generowanie

- Lepiej rozumie naturalne polecenia i instrukcje użytkownika

- Benchmarki: czasem słabszy w akademickich testach, ale lepszy w ogólnym „inteligentnym” flow tekstu

- Przykład użycia: tworzenie strukturalnych planów projektów, streszczenia, kreatywne treści

🔥 Przykład realnej różnicy

Prompt: „Stwórz szczegółowy plan rozwiązania problemu matematycznego i logicznego”

- Qwen2.5‑7B → dokładne kroki, logiczne wnioskowanie, szybkie i precyzyjne

- Mistral‑7B → bardziej płynne i rozbudowane wytłumaczenie, lepsze dla ogólnych instrukcji i kreatywnego flow

Rekomendowane: Mistral‑7B‑Instruct‑v0.3‑GGUF + Q8_0 lub F16